欧洲杯投注入口艺术家们将OpenAI比作“中叶纪的封建领主”-欧洲杯下单平台官方平台手机版下载-欧洲杯赛事直播

每经记者 蔡鼎 每经实习记者 岳楚鹏 每经裁剪 兰素英 欧洲杯投注入口

一直被外界交付极高渴望的OpenAI文生视频AI模子Sora自本年2月初次展示以来,就莫得任何干于何时负责发布的音问了。当地时间11月26日,一些据称参与了Sora测试的艺术家泄漏了该模子的看望权限(API),以抗议OpenAI对他们的压榨步履。

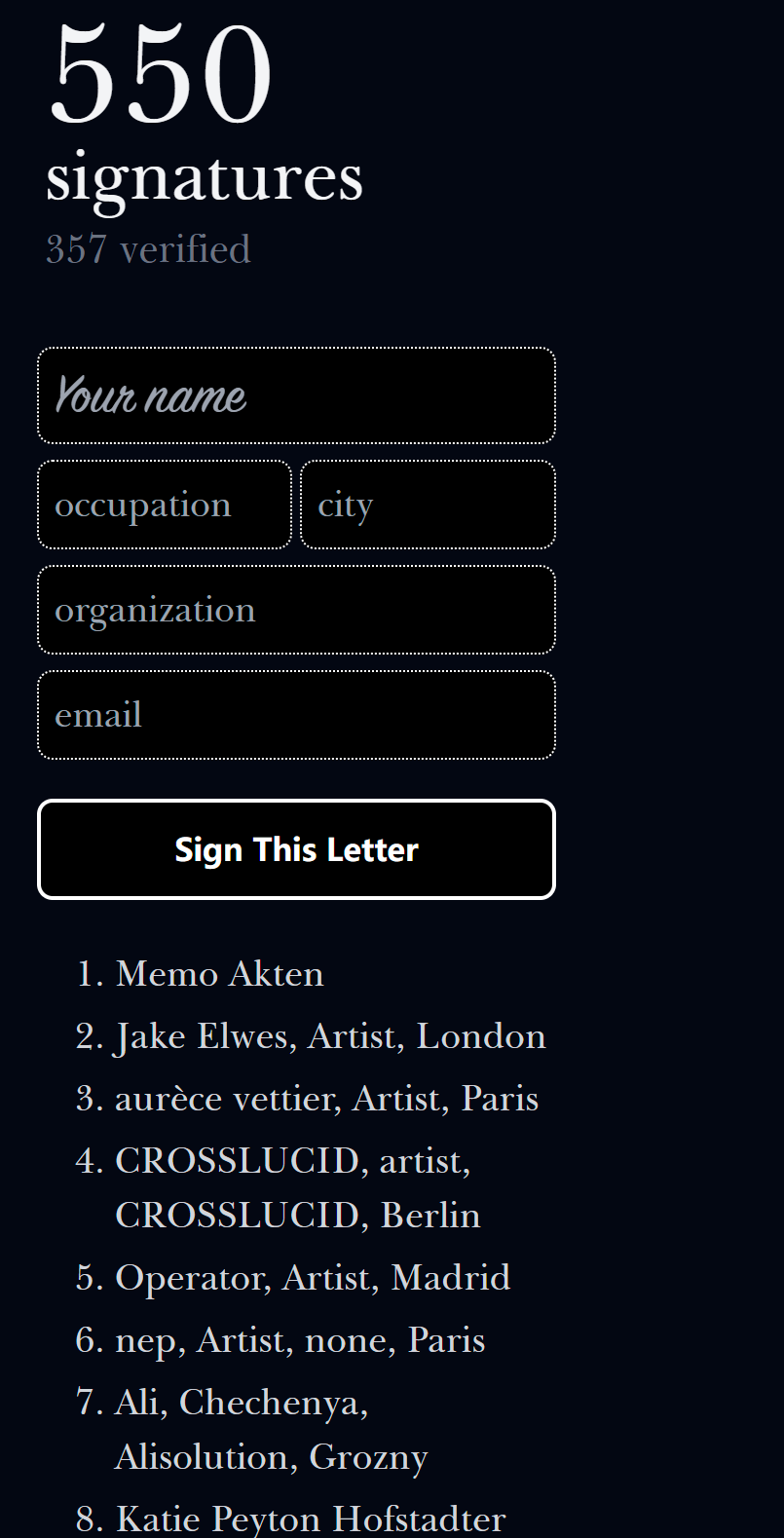

当日,环球AI模子社区Hugging Face片刻出现了一个文生视频的风景。风景团队使用他们的身份考证令牌(可能来自早期看望系统)创建了一个前端,让所有Hugging Face的用户不错使用Sora生成视频。

图片起首:Hugging Face风景截图

图片起首:Hugging Face风景截图

通过这一前端,用户不错通过输入节略的笔墨描述来生因素辨率高达1080p的10秒视频。但风景创建三个小时后,OpenAI就关闭了所有艺术家对Sora的早期看望权限。现在该风景已无法使用。在短短的三小时内,用户通过这一项生分红了87个视频并发布了出来。

现在OpenAI并莫得公开阐明所谓的Sora泄漏是否属实。但是OpenAI强调,参与其“推敲预览”是“自觉的,莫得义务提供反馈或使用该器具”。

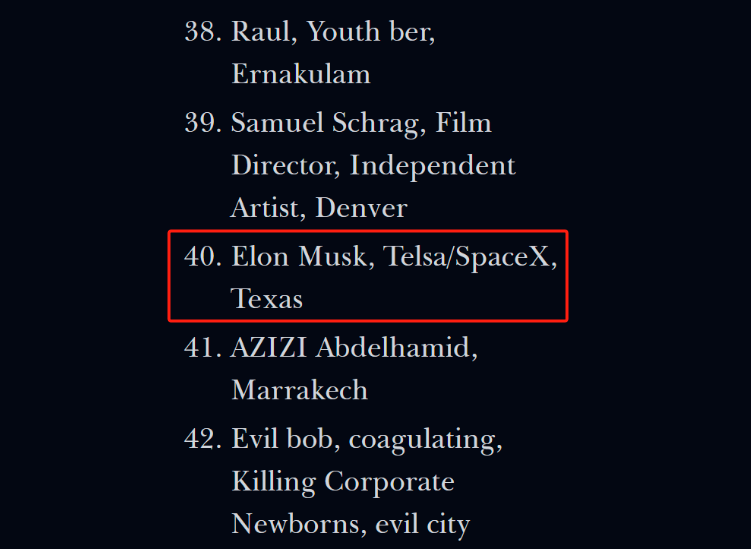

OpenAI暂停Sora看望权限这一举动也暴显现AI行业的透明度问题。随后,该艺术家团体发布了一个公开信网站,饱读舞任何与他们有换取不雅点的东说念主签署这封公开信。赶走发稿,这封信还是收到550个签名,包括马斯克。

当地时间11月26日,一小群参与Sora测试的艺术家在Hugging Face泄漏了Sora的看望权限,以抒发对OpenAI的动怒。风景团队使用他们的身份考证令牌(可能来自早期看望系统)创建了一个前端,让所有Hugging Face的用户不错使用Sora生成视频。

此前,OpenAI向数百名艺术家通达了Sora的早期使用权,以测试这款新的AI视频生成器。但部分艺术家觉得,OpenAI运用了他们的无偿管事,并运用他们来莳植公司形象。

为引起外界对OpenAI这一排为的调节,他们在环球AI模子社区Hugging Face上发布了一个在线风景,允许公众使用Sora生成视频。

随风景同期发布的还有一封言辞浓烈的公开信。在信中,艺术家们将OpenAI比作“中叶纪的封建领主”,谴责他们运用了艺术家的忘我孝顺,却并莫得给出合理的报答。“咱们获取了Sora的使用权,并承诺成为早期测试者、红队成员和创意配合资伴。然则,咱们觉得,咱们被指挥进行‘艺术洗白’,以告诉宇宙Sora对艺术家来说是一个有用的器具。”

这封信充斥着对OpenAI的动怒,艺术家们写说念:“咱们不是你的无偿研发东说念主员。咱们不是你的:免费失误测试东说念主员、PR(公关)傀儡、教师数据和考证令牌。”

尽管参与模子测试的艺术家稀有百名,但唯有少数作品进行展映,况且报答极为有限,与OpenAI获取的普遍公关和营销价值比较,几乎是微不及说念。更让这些艺术家们震怒的是,“每个影片齐需要OpenAI团队的批准材干共享。这个早期看望贪图似乎更多调节的是公关和告白,而不是创作抒发和品评。”

他们在信中强调,“咱们并不反对将AI本领行为艺术器具使用(淌若咱们反对,可能就不会干涉这个风景)。咱们不快乐的是艺术家项贪图推出方式,以及该器具在可能公开辟布之前的呈现方式。咱们发布这个声明,但愿OpenAI能变得愈加通达,对艺术家愈加友好,并在复古艺术方面不仅仅公关造假。”

他们还号召其他艺术家们使用开源的视频生成器具来禁止OpenAI这种闭源公司。“开源视频生成器具让艺术家纰漏在莫得门槛、生意利益或服务于任何公司的公关贪图下,探索时尚艺术。咱们也饱读舞艺术家使用我方的数据集来教师我方的模子。”

但在艺术家们上线Sora API风景后三小时,OpenAI连忙割断了看望权限。OpenAI发言东说念主Niko Felix称,公司将暂停所有用户对Sora的看望,同期侦探情况。但是他拒却诠释这个风景是不是的确链接到了Sora模子。“Sora仍处于推敲预览阶段,咱们正奋发在创造力与更昔时的苍劲安全法子之间取得均衡。”

Felix同期说说念:“咱们alpha版块的数百名艺术家塑造了Sora的发展,匡助笃定新功能和保险法子的优先级。参与是自觉的,莫得提供反馈或使用该器具的义务。咱们很欢娱为这些艺术家提供免费看望权限,并将不息通过赠款、行动和其他贪图为他们提供复古。咱们肯定AI不错成为一种苍劲的创意器具,并悉力于让Sora既实用又安全。”

在OpenAI暂停Sora看望权限后,该艺术家团体发布了一个公开信网站,饱读舞任何与他们有换取不雅点的东说念主签署这封公开信。

赶走发稿,这封信还是收到550个签名,与OpenAI极其不勉强的马斯克也在其中。

此次事件在AI行业中并不常见,因为早期测试东说念主员的反馈受到公司的严格范畴,况且严厉的品评很少公开。时时,公司会躬行挑选哪些外部东说念主员不错提前看望系统,在某些情况下,公司会条款这些用户签署守秘契约或获取批准,然后材干公开共享系统生成的任何图像、视频或文本反应。

但最近,越来越多的AI安全大众品评这种作念法对寂然推敲产生了寒蝉效应,裁减了透明度,并阻拦了对公司步履的问责。斯坦福大学的基础模子透明度指数炫夸,莫得一家主要的基础模子开辟商纰漏提供弥漫的透明度(最高得分54分,满分100分),这揭示了AI行业短少透明度。

OpenAI的职工此前也攻讦公司免强职工签署“封口契约”,不允许下野职工发表对公司负面言论,不然公司不错收回职工已有股权。下野职工也不得对外公开这些契约实质。

为此,本年六月,OpenAI和谷歌DeepMind的一批职工勾通发布了一份名为《对AI发出警告》的公开信。

公开信预警,AI本领存在加重不对等,左右和误导信息,失去范畴并挟制东说念主类的风险。AI公司本领迭代的同期产生了大宗安全有关的非公开信息,它们莫得主动表现的动机。监管部门对此难以酿成有用制约,只可由现任或前任职工条款它们向公众负责。

上述职工在公开信中对包括OpenAI在内的AI公司建议了四点号召:其一,不免强职工顽强谢绝品评公司的契约;其二,为公司现任和前任职工提供匿名的安全反馈机制;其三,允许现任和前任职工向董事会、监管机构、其他安全机构建议对公司本领安全的担忧;其四,公司分辩公开共享风险有关机密信息的现任和前任职工进行膺惩。

正如Hugging Face的一则指摘所说,“AI并非捏造而来。它补助在创意东说念主员的肩膀上,而这些创意东说念主员经常莫得得到招供。Sora泄密事件敲响了警钟:莫得说念德的革命即是克扣。”

海量资讯、精确解读,尽在新浪财经APP

海量资讯、精确解读,尽在新浪财经APP

职守裁剪:王许宁 欧洲杯投注入口